Серьезные люди

Серьезные люди

Единственный магазин, который мне захотелось пошарить в фейсбуке и купить там половину футболок)

Есть слово, которое я пишу очень часто и почти всегда с ошибкой. Потом ее замечаю, и исправляю. Но вот написать сразу без ошибки не могу уже многие годы). Это перевод на английский слова “произношение”. Вот сейчас, после того, как разобрался, буду писать правильно с первого раза. Потому что знаю, что виной всему трисиллабическое сокращение 🙂

А еще мы тут недавно поняли, почему американцы не понимают сразу о каком таком фаунтайнс идет речь, когда мы упоминаем название нашего жилого комплекса (Fountains of Mclean). Оказалось, это не фаунтайнс, а фАн-тинс, ну и вдобовок не маклиин, а маклэйн 🙂

#английский

Ух, тетенька зажигает (Татьяна Шмайлюк)

Прям теория заговора

“On The Beatles’ first British album, Please Please Me, 57% of the songs had these and other personal pronouns in them, 64% of the songs on their second album With the Beatles, and 79% on their third, Hard Days Night. For Please Please Me, the site counted 325 personal pronouns in 19 minutes 30 seconds of music, an average of approximately one pronoun every 3.6 seconds.”

https://bigthink.com/robby-berman/the-beatles-hit-making-secret-ingredient-personal-pronouns

https://bigthink.com/robby-berman/the-beatles-hit-making-secret-ingredient-personal-pronouns

задался вопросом, почему в английском рыжих называют redhead, а не orangehead или как-то так, ведь там красного значительно меньше, чем оранжевого или даже желтого. Оказалось, что слово появилось тогда, когда red означало все оттенки от оранжевого до красного, а для оранжевого слова просто не было – оно появилось с появлением апельсинов. Лиса вот тоже red fox, хотя казалось бы.

Почему англичанам не пришло в голову назвать оранжевый цвет по цвету тыквы или моркови «Pumpkin» или «Carrot«? Зачем было ждать, пока в Англию не завезли апельсины? Все очень просто. На самом деле и тыква, и морковь бывают не только оранжевого цвета. Как известно, тыквы бывают и желтого, и зеленого, и ярко оранжевого цвета, а морковь раньше была не оранжевая, а сиреневая. Что касается апельсинов, то они исключительно оранжевого цвета, поэтому, слово «orange» – стало идеальным для названия цвета.

Однако в английском языке есть еще одно слово, означающее «рыжеволосый» — ginger – образованное от слова «имбирь» — еще одна загадка, поскольку корень имбиря золотисто-желтый, а не оранжевый, и словом ginger логичнее было бы назвать блондинок, а не рыжих.

Пианистка Виктория Ермолаева, отличный канал https://www.youtube.com/watch?v=T6WzfhGwkiU

У вас тоже мак так странно считает?)

Есть спецы по Machine Learning и AI?

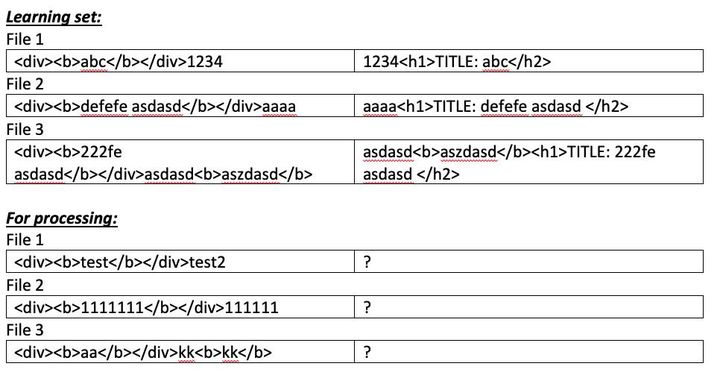

Как можно решить такую задачу: есть два комплекта HTML-файлов с почти одинаковым контентом, но разной версткой – назовем его training set, и один комплект в дизайне №1. Задача – получить для этого последнего комплекта набор файлов в дизайне №2 – назовем его for processing, используя знания, полученные из training set, в лучшем возможном виде.

В training set у каждой пары A и B есть фрагменты, которые можно назвать “шаблоном”, и фрагменты, которые можно назвать “данными”. Например, заголовок статьи – данные, а обертка вокруг него – шаблон. После обработки N файлов система должна определить где данные, а где – шаблон, причем как в дизайне №1, так и в дизайне №2, а также уметь распознавать данные в файлах в дизайне №1 из for processing, и вставлять их в соответствующие места шаблона дизайна №2 для каждого из файлов for processing.

Как это сделать?

Ниже рассуждения вслух, в фейсбуке сохраняю для себя. Если в теме – подключайтесь)

Первое, что приходит в голову, это переводить файлы в связанный список тегов и фрагментов текста как для дизайна№1, так и для его counterpart в дизайне №2. Затем искать одинаковые фрагменты максимальной длины во всех файлах дизайна №1 – эти фрагменты будут с большой вероятностью частью шаблона. Одинаковые фрагменты, стоящие рядом – объединять в один покрупнее, но при этом сохранять и составляющие кусочки. Получится такой набор деревьев, с вершинами, состоящими из тегов и букв, и корнями, состоящими из больших фрагментов, которые в обоих файлах одинаковые. Сделать это для всех оставшихся пар файлов, получить тучу подобных деревьев. Далее нужно обработать деревья и найти максимально крупные фрагменты, общие у большинства. Общие фрагменты в дизайне №1 будут предложены как шаблон, а различающиеся – как элементы данных.

Подобный анализ проводится и для дизайна №2.

Фрагменты, помеченные как данные, сопоставляются автоматически, так как по идее должно быть полное соответствие. Если в отдельных случаях нет полного соответствия, опираемся на большинство.

В итоге, для дизайна №1 и дизайна №2 у нас получаются две последовательности, состоящие из узлов “фрагмент шаблона” и “фрагмент данных”. Именуем последовательности, присваивая одинаковые имена фрагментам данных у последовательности для дизайна №1 и последовтаельности для дизайна №2. Шаблоны просто нумеруем.

Далее обрабатываем дизайн №1 у for processing, выделяя у него фрагменты, помеченные как шаблон у learning set. Если они идут в том же порядке, то между ними – данные. А они уже помечены, и собираем данные в порядке, заданном результатами обработки дизайна №2. Если какие-то фрагменты не находятся, то помечаем данные штуки для ручной обработки. Если какие-то данные не находятся – то просто забиваем.

Эти решения далее вручную корректируются аналитиком.

Но такой подход работать не будет, если learning set содержит списки переменной длины, такие как список товаров, например. Система не назовет дизайн №1 похожим для 10 товаров и для 20. Она получит последовательности “фрагмент шаблона” и “фрагмент данных” разной длины, и после обработки статистически получит какую-то одну последовательность. Теоретически, можно отдельным механизмом находить паттерны повторяющиеся, и как-то это помечать.

Вдруг кто-то знает готовые решения или подходы к решению задачи? Интересная тема ж.